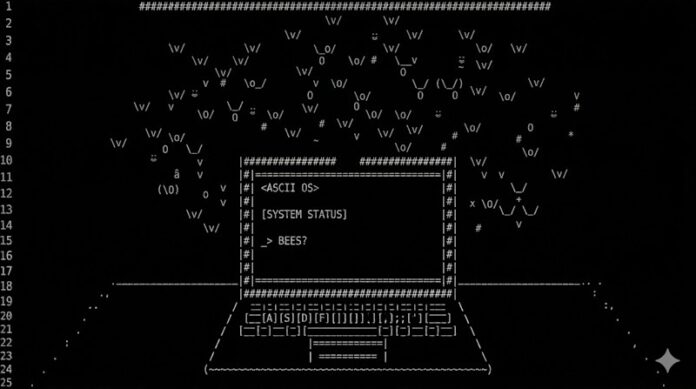

O cenário da inteligência artificial está mudando. Embora os grandes modelos de linguagem (LLMs) demonstrem capacidades brutas impressionantes, traduzir esse poder em produtividade consistente e no mundo real continua a ser um grande desafio. O gargalo não é a inteligência, mas o gerenciamento da inteligência de forma eficaz, especialmente para tarefas de engenharia complexas e de longo prazo. A startup Random Labs, com sede em São Francisco, apoiada pela Y Combinator, acredita ter uma solução: Slate V1, o primeiro agente de codificação autônomo “nativo do enxame”.

O problema dos sistemas e a ascensão dos fluxos de trabalho agentes

Durante anos, as ferramentas de codificação assistidas por IA têm lutado com janelas de contexto e com a manutenção da coerência em projetos estendidos. Simplesmente lançar um LLM poderoso em uma base de código complexa geralmente resulta em resultados fragmentados e não confiáveis. Slate aborda isso implementando uma abordagem fundamentalmente diferente: uma estrutura de execução distribuída e paralela inspirada em mentes colméias biológicas e no design de sistemas operacionais.

Como funciona a “tecelagem de fios” do Slate

O Slate não trata os modelos de IA como solucionadores de problemas monolíticos. Em vez disso, ele divide as tarefas em “threads” discretos e gerenciáveis que são despachados para agentes de trabalho especializados – potencialmente usando diferentes LLMs para diferentes etapas. Isto aproveita o que a Random Labs chama de “excesso de conhecimento” – o potencial inexplorado dos modelos quando não estão sobrecarregados com demandas estratégicas e táticas simultâneas.

O sistema usa uma linguagem específica de domínio (DSL) baseada em TypeScript para orquestrar esses threads, agindo como um “kernel” central que gerencia o fluxo de execução enquanto os “processos” de trabalho lidam com operações específicas. Isto reflete um sistema operacional, tratando a janela de contexto limitada do LLM como uma RAM preciosa que deve ser gerenciada de forma inteligente.

Memória Episódica e Execução Paralela

Uma inovação importante é o sistema de “memória episódica” do Slate. Ao contrário das ferramentas tradicionais de IA que dependem da compactação com perdas de interações anteriores, o Slate compacta apenas chamadas de ferramentas e conclusões bem-sucedidas em resumos concisos. Esses resumos são compartilhados diretamente com o orquestrador, mantendo uma inteligência de “enxame” coerente.

Essa arquitetura permite um paralelismo massivo. Um desenvolvedor pode, por exemplo, ter Claude Sonnet orquestrando um refatorador complexo enquanto o GPT-5.4 executa o código e o GLM 5 pesquisa a documentação simultaneamente. Essa implantação seletiva de modelo garante economia: usando modelos de alta potência somente quando sua profundidade estratégica é necessária e modelos mais baratos para tarefas mais simples.

Estratégia Comercial e Integração Futura

Atualmente, a Random Labs opera em um modelo de crédito baseado no uso, com ferramentas de cobrança em tempo real para equipes profissionais. A empresa planeja integrar-se diretamente ao Codex da OpenAI e ao Claude Code da Anthropic, posicionando o Slate como uma camada de orquestração superior, em vez de um concorrente das interfaces nativas desses modelos.

Resultados iniciais de estabilidade

Testes internos sugerem que o Slate é notavelmente estável. Uma versão anterior passou em 2/3 dos testes na tarefa make-mips-interpreter, uma referência onde mesmo LLMs de última geração geralmente falham em mais de 80% das vezes. Essa estabilidade, combinada com sua capacidade de escalar como uma organização, sugere que o Slate está evoluindo além de uma simples ferramenta para se tornar um parceiro colaborativo para desenvolvedores.

O Slate V1 representa uma mudança na codificação assistida por IA: de interfaces baseadas em chat para fluxos de trabalho distribuídos e orquestrados. O futuro poderá ver engenheiros humanos dirigindo principalmente essas “mentes coletivas”, delegando tarefas complexas a agentes especializados de IA trabalhando em conjunto.