Il panorama dell’intelligenza artificiale sta cambiando. Sebbene i modelli linguistici di grandi dimensioni (LLM) dimostrino capacità grezze impressionanti, tradurre tale potere in produttività coerente e reale rimane una sfida importante. Il collo di bottiglia non è l’intelligenza, ma la gestione dell’intelligenza in modo efficace, soprattutto per compiti ingegneristici complessi a lungo termine. La startup Random Labs con sede a San Francisco, sostenuta da Y Combinator, ritiene di avere una soluzione: Slate V1, il primo agente di codifica autonomo “nativo dello sciame”.

Il problema dei sistemi e l’ascesa dei flussi di lavoro agenti

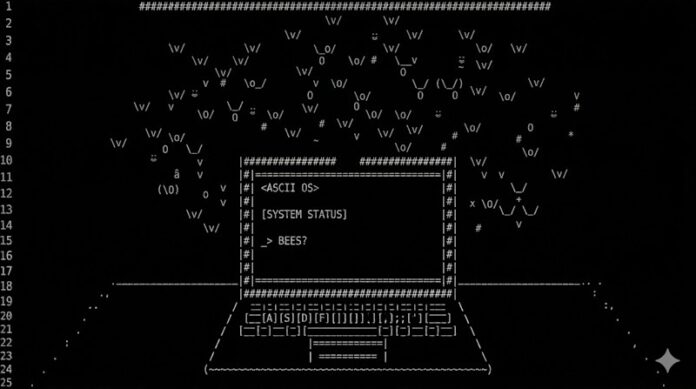

Per anni, gli strumenti di codifica assistiti dall’intelligenza artificiale hanno avuto difficoltà con le finestre di contesto e con il mantenimento della coerenza su progetti estesi. Il semplice lancio di un potente LLM su una base di codice complessa spesso si traduce in un output frammentato e inaffidabile. Slate affronta questo problema implementando un approccio fondamentalmente diverso: un framework di esecuzione distribuito e parallelo ispirato alle menti biologiche dell’alveare e alla progettazione del sistema operativo.

Come funziona la “tessitura del filo” di Slate

Slate non tratta i modelli di intelligenza artificiale come risolutori di problemi monolitici. Invece, suddivide le attività in “thread” discreti e gestibili che vengono inviati ad agenti lavoratori specializzati, utilizzando potenzialmente LLM diversi per passaggi diversi. Ciò sfrutta ciò che Random Labs chiama “Knowledge Overhang”, il potenziale non sfruttato dei modelli quando non sono sovraccarichi di richieste strategiche e tattiche simultanee.

Il sistema utilizza un Domain Specific Language (DSL) basato su TypeScript per orchestrare questi thread, agendo come un “kernel” centrale che gestisce il flusso di esecuzione mentre i “processi” di lavoro gestiscono operazioni specifiche. Ciò rispecchia un sistema operativo, trattando la finestra di contesto limitato di LLM come preziosa RAM che deve essere gestita in modo intelligente.

Memoria episodica ed esecuzione parallela

Un’innovazione chiave è il sistema di “memoria episodica” di Slate. A differenza degli strumenti di intelligenza artificiale tradizionali che si basano sulla compressione con perdite delle interazioni passate, Slate comprime solo le chiamate e le conclusioni degli strumenti riuscite in riepiloghi concisi. Questi riepiloghi vengono condivisi direttamente con l’orchestratore, mantenendo un’intelligenza “sciame” coerente.

Questa architettura consente un parallelismo massiccio. Uno sviluppatore può, ad esempio, chiedere a Claude Sonnet di orchestrare un refactoring complesso mentre GPT-5.4 esegue il codice e GLM 5 ricerca la documentazione contemporaneamente. Questa implementazione selettiva del modello garantisce efficienza in termini di costi: utilizzo di modelli ad alta potenza solo quando è necessaria la loro profondità strategica e modelli più economici per compiti più semplici.

Strategia commerciale e integrazione futura

Random Labs sta attualmente operando su un modello di credito basato sull’utilizzo, con strumenti di fatturazione in tempo reale per i team di professionisti. La società prevede di integrarsi direttamente con Codex di OpenAI e Claude Code di Anthropic, posizionando Slate come un livello di orchestrazione superiore piuttosto che un concorrente delle interfacce native di questi modelli.

Risultati iniziali di stabilità

Test interni suggeriscono che Slate è notevolmente stabile. Una prima versione ha superato 2/3 dei test sull’attività make-mips-interpreter, un punto di riferimento in cui anche i LLM all’avanguardia spesso falliscono più dell’80% delle volte. Questa stabilità, combinata con la sua capacità di scalare come un’organizzazione, suggerisce che Slate si sta evolvendo da un semplice strumento a un partner collaborativo per gli sviluppatori.

Slate V1 rappresenta un cambiamento nella codifica assistita dall’intelligenza artificiale: dalle interfacce basate su chat a flussi di lavoro orchestrati e distribuiti. Il futuro potrebbe vedere gli ingegneri umani dirigere principalmente queste “menti alveare”, delegando compiti complessi ad agenti specializzati nell’intelligenza artificiale che lavorano di concerto.