Le paysage de l’intelligence artificielle est en train de changer. Même si les grands modèles de langage (LLM) démontrent des capacités brutes impressionnantes, traduire cette puissance en une productivité cohérente et réelle reste un défi majeur. Le goulot d’étranglement n’est pas l’intelligence, mais la gestion efficace de l’intelligence, en particulier pour les tâches d’ingénierie complexes et à long terme. La startup Random Labs, basée à San Francisco, soutenue par Y Combinator, pense avoir une solution : Slate V1, le premier agent de codage autonome « en essaim natif ».

Le problème des systèmes et l’essor des workflows agentiques

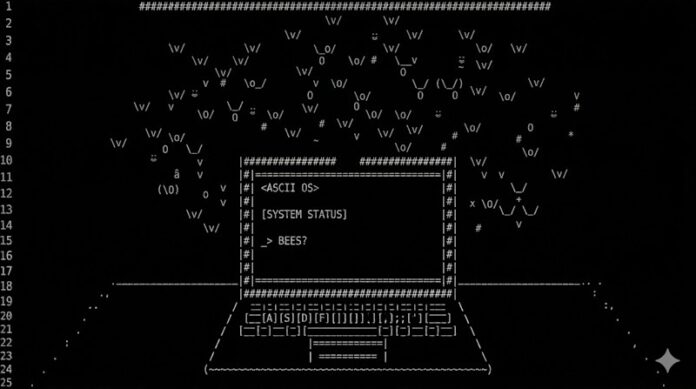

Pendant des années, les outils de codage assistés par l’IA ont eu du mal à gérer les fenêtres contextuelles et à maintenir la cohérence sur des projets étendus. Le simple fait de lancer un LLM puissant sur une base de code complexe aboutit souvent à une sortie fragmentée et peu fiable. Slate s’attaque à ce problème en mettant en œuvre une approche fondamentalement différente : un cadre d’exécution distribué et parallèle inspiré de l’esprit des ruches biologiques et de la conception du système d’exploitation.

Comment fonctionne le « tissage de fil » de Slate

Slate ne considère pas les modèles d’IA comme des solutions monolithiques aux problèmes. Au lieu de cela, il décompose les tâches en « threads » distincts et gérables qui sont distribués à des agents de travail spécialisés, en utilisant potentiellement différents LLM pour différentes étapes. Cela exploite ce que Random Labs appelle « l’excédent de connaissances » : le potentiel inexploité des modèles lorsqu’ils ne sont pas surchargés d’exigences stratégiques et tactiques simultanées.

Le système utilise un langage spécifique au domaine (DSL) basé sur TypeScript pour orchestrer ces threads, agissant comme un « noyau » central qui gère le flux d’exécution tandis que les « processus » de travail gèrent des opérations spécifiques. Cela reflète un système d’exploitation, traitant la fenêtre contextuelle limitée du LLM comme une précieuse RAM qui doit être gérée intelligemment.

Mémoire épisodique et exécution parallèle

Une innovation clé est le système de « mémoire épisodique » de Slate. Contrairement aux outils d’IA traditionnels qui reposent sur la compression avec perte des interactions passées, Slate compresse uniquement les appels d’outils réussis et les conclusions dans des résumés concis. Ces synthèses sont directement partagées avec l’orchestrateur, maintenant une intelligence « en essaim » cohérente.

Cette architecture permet un parallélisme massif. Un développeur peut, par exemple, demander à Claude Sonnet d’orchestrer un refactor complexe pendant que GPT-5.4 exécute le code et que GLM 5 recherche simultanément la documentation. Ce déploiement sélectif de modèles garantit la rentabilité : utiliser des modèles puissants uniquement lorsque leur profondeur stratégique est nécessaire, et des modèles moins chers pour des tâches plus simples.

Stratégie commerciale et intégration future

Random Labs fonctionne actuellement sur un modèle de crédit basé sur l’utilisation, avec des outils de facturation en temps réel pour les équipes professionnelles. La société prévoit de s’intégrer directement au Codex d’OpenAI et au Code Claude d’Anthropic, positionnant Slate comme une couche d’orchestration supérieure plutôt que comme un concurrent des interfaces natives de ces modèles.

Premiers résultats de stabilité

Les tests internes suggèrent que Slate est remarquablement stable. Une première version a réussi les 2/3 des tests sur la tâche make-mips-interpreter, une référence où même les LLM les plus avancés échouent souvent dans plus de 80 % du temps. Cette stabilité, combinée à sa capacité à évoluer comme une organisation, suggère que Slate évolue au-delà d’un simple outil pour devenir un partenaire de collaboration pour les développeurs.

Slate V1 représente un changement dans le codage assisté par l’IA : des interfaces basées sur le chat aux flux de travail orchestrés et distribués. L’avenir pourrait voir des ingénieurs humains diriger principalement ces « esprits-ruches », déléguant des tâches complexes à des agents spécialisés en IA travaillant de concert.