Один з роликів у профілі видання the daily mail в соціальній мережі facebook, в якому були присутні темношкірі чоловіки, був автоматично відзначений як відео з приматами. Користувачі звернули увагу, що соцмережа пропонує «продовжити дивитися відео про приматів», що спонукало компанію провести розслідування і зупинити роботу відповідного алгоритму. Facebook вже принесла вибачення, назвавши те, що трапилося «неприпустимою помилкою».

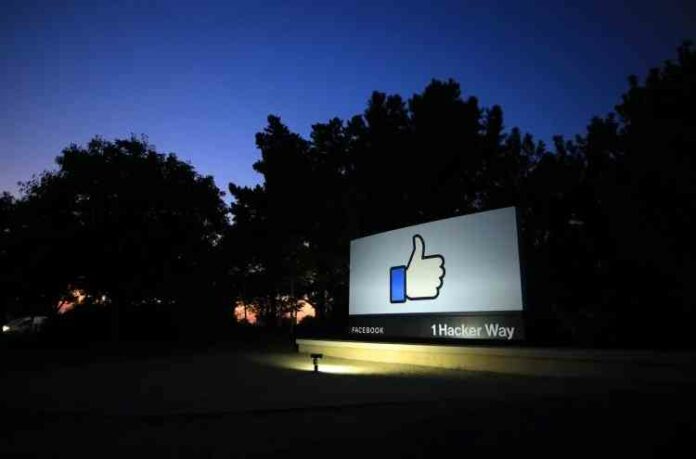

Зображення: jim wilson / the new york times

Йдеться про відео, яке з’явилося в профілі the daily mail 27 червня. У ньому демонструються сутички темношкірих чоловіків з білими цивільними особами і поліцейськими. Ролик не має ніякого відношення до приматів. Представники компанії провели розслідування, за результатами якого функціонування дає рекомендації ші-алгоритму було призупинено.

” як ми вже говорили, незважаючи на те, що ми працюємо над поліпшенням штучного інтелекту, ми знаємо, що він недосконалий і нам ще належить багато роботи. Ми приносимо свої вибачення всім, хто міг побачити ці образливі рекомендації», — прокоментувала дане питання прес-секретар facebook дені левер (dani lever).

Зображення: the new york times

Відзначимо, що google, amazon та інші технологічні гіганти вже багато років перебувають під пильною увагою через упередженість створюваних ними алгоритмів, особливо в расових питаннях. Дослідження показали, що технологія розпізнавання осіб упереджено ставиться до темношкірих людей і насилу ідентифікує їх, через що сталося кілька інцидентів, коли темношкірі піддавалися дискримінації або безпричинним арештам.

Випадки, подібні нинішньому, траплялися і раніше. Наприклад, в 2015 році сервіс google фото позначив кілька знімків з темношкірими людьми як зображення «горили», за що google довелося приносити вибачення. Тоді ж було оголошено, що компанія буде працювати над негайним усуненням проблеми. Більш ніж через два роки було встановлено, що google вирішила питання шляхом цензурування слова “горила «в пошукових запитах, а також частковим блокуванням слів» шимпанзе «і»мавпа”.